Umělá inteligence je všude, a to i v nejvyšších patrech moci v jednotlivých zemích. Nejnověji to potvrzuje Ulf Kristersson, švédský premiér, který veřejně přiznal, že při své vládní práci konzultuje nástroje umělé inteligence, jako je ChatGPT, aby získal „druhý názor“. A to se zjevně nelíbí mnoha švédským občanům.

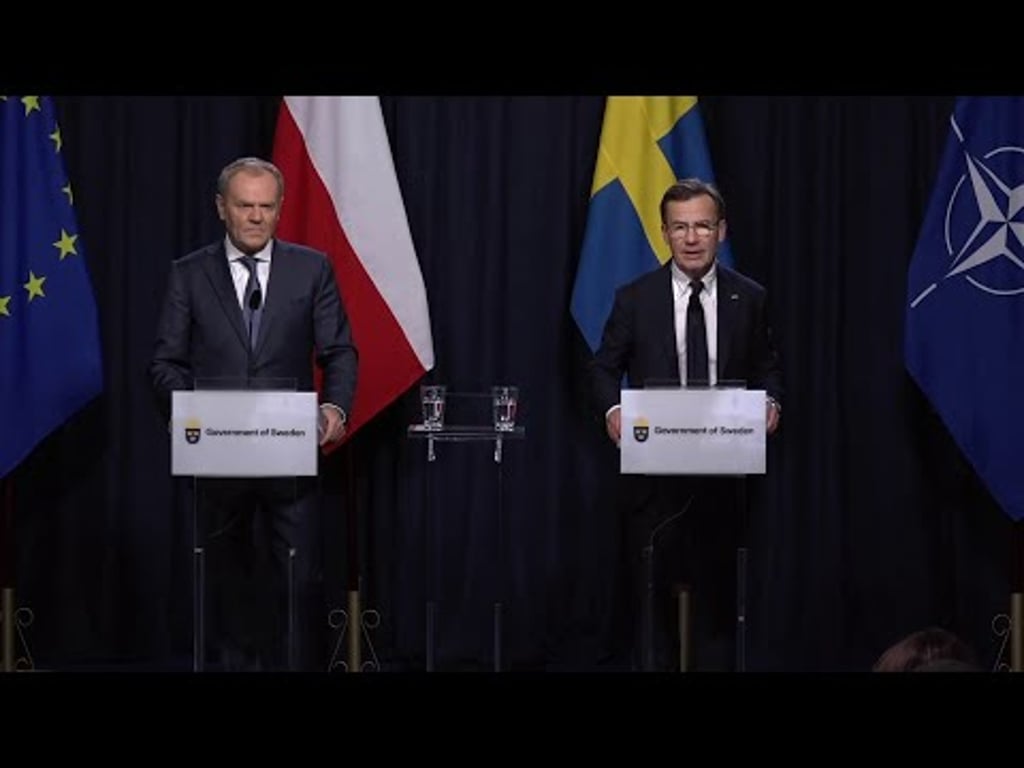

Kristersson, předseda strany Umírnění, která vede středopravou koalici ve Švédsku, vysvětlil deníku Dagens industri, že on a jeho kolegové používají některé prvky umělé inteligence při své každodenní práci. Vysvětluje to následovně:

„Používám ji poměrně často. Už jen proto, abychom získali druhý názor – co udělali ostatní a měli bychom si myslet opak? Takový druh otázek.“

Umělá inteligence jako poradce předsedy vlády

Reakce byly samozřejmě rychlé. Technologičtí experti vyjádřili obavy ze závislosti politiků na těchto nástrojích. Vlivný celostátní deník Aftonbladet dokonce zašel tak daleko, že obvinil premiéra, že propadl „psychóze AI oligarchů“.

Zdroj: Youtube.com

Skutečné obavy o bezpečnost. Informace, které vrcholná moc v zemi kontroluje, jsou z hlediska národní bezpečnosti velmi citlivé. Logicky není nejlepší je sdílet s umělou inteligencí, a proto jsme viděli, kolik společností zakázalo svým zaměstnancům používat umělou inteligenci, aby nedošlo k úniku informací, nebo dokonce vlády, jako jsou USA, zakazují nástroje se servery v Číně, aby se zabránilo špehování.

Právě o to se dělí Simone Fischer-Hübnerová, výzkumná pracovnice v oblasti počítačových věd na Karlstadské univerzitě, která upozorňuje na nebezpečí při nakládání s citlivými informacemi na těchto platformách. Reakce vládního mluvčího byla rychlá a poukázal na to, že premiér nepoužívá umělou inteligenci s žádným rizikem, protože nezavádí „citlivé informace“. Poukazuje na to, že se používá „jako obecný odkaz“.

Argumenty odborníků však přesahují rámec bezpečnosti. Virginia Dignumová, odpovědná profesorka umělé inteligence na univerzitě v Umea, poukázala na zásadní problém: AI nemá schopnost nabídnout skutečný politický názor. Pouze odráží a reprodukuje názory programátora a materiály použité k jejímu tréninku. Vysvětluje to následovně:

Čím více se v jednoduchých věcech spoléháte na umělou inteligenci, tím větší je riziko, že se na systém budete příliš spoléhat. Je to kluzký svah.

Kritika tohoto odborníka však vyvrcholila větou, která již nepochybně rezonuje celým Švédskem:

„Musíme požadovat, aby bylo možné zaručit spolehlivost. Nevolili jsme ChatGPT.„

Když mluvíme o tak důležitém úkolu, jako je posunutí země kupředu, svěřit rozhodování ChatGPT je sporné. Zejména proto, že může velmi rychle zkreslit názor informacemi, které nasbírala z různých míst při svém školení. A nezapomínejme, že umělá inteligence není dokonalá a může halucinovat tím, že nabízí chybné nebo zcela vymyšlené údaje. To může zkreslit důležité rozhodnutí.

Kdo může využívat umělou inteligenci v práci?

Využívání AI ve státní správě navíc vyvolává etické otázky ohledně transparentnosti a odpovědnosti – kdo nese odpovědnost, pokud se rozhodnutí založené na doporučení AI ukáže jako škodlivé? To jsou otázky, které musí vlády po celém světě zvážit při začleňování pokročilých technologií do svých rozhodovacích procesů.

Zdroj: Youtube.com

Není to však jediná kontroverze, do které se tento politik v technologické oblasti zapletl. Ještě před několika týdny bylo nalezení polohy jedné z nejdůležitějších osobností Švédska poměrně snadné. To vše díky aplikaci Strava, která zaznamenávala trasy, po nichž se pohybovali premiérovi bodyguardi, a ukazovala, jaké cesty vykonal a kde se díky své zálibě v běhání v přírodě neustále nacházel.

Tento incident poukazuje na nutnost, aby si političtí představitelé a jejich týmy uvědomovali bezpečnostní důsledky technologií, které používají, a to nejen kvůli ochraně citlivých informací, ale také kvůli zajištění vlastní bezpečnosti.